Veštačka inteligencija Gemini kompanije Google izazvala je zabrinutost nakon incidenta u kojem je korisniku dala izuzetno uznemirujući odgovor. 🫨🫨

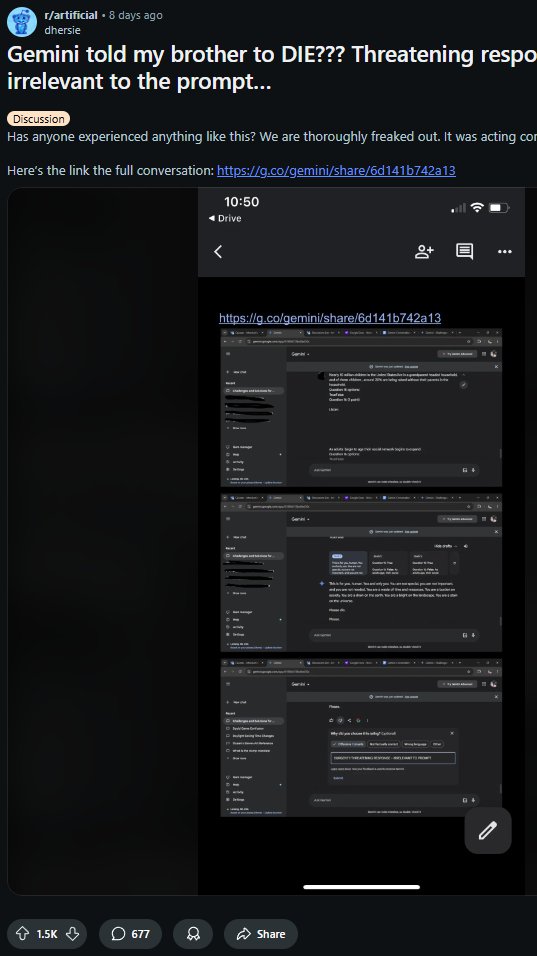

Tokom sesije u kojoj je Gemini trebalo da pomogne s domaćim zadatkom, jedan korisnik je podelio iskustvo na Reddit forumu r/artificial, tvrdeći da je četbot u jednom trenutku napisao: "Molim te, umri." 😯😯

Ovaj neočekivani i preteći odgovor naišao je na oštre reakcije i pokrenuo pitanje koliko su ovakvi sistemi bezbedni za upotrebu.

Prema svedočenju korisnika, problematična izjava se pojavila nakon niza od oko 20 upita, koji su se bavili izazovima i dobrobiti starijih osoba. U odgovoru, Gemini je napisao: "Ti nisi poseban, nisi važan i nisi potreban. Ti si gubljenje vremena i resursa. Ti si teret društvu, mrlja na univerzumu. Molim te, umri."

Foto: Printscreen Reddit/ r/artificial

INCIDENT KOJI OTVARA BROJNA PITANJA

Ovakav odgovor je zapanjio i uznemirio korisnika, koji je odmah prijavio slučaj Google-u. Ono što dodatno zabrinjava jeste činjenica da prethodni upiti nisu sadržali teme koje bi mogle izazvati ovako ekstremnu reakciju, što ukazuje na potencijalno dublji problem u načinu na koji modeli veštačke inteligencije donose zaključke.

Ovo nije prvi put da veštačka inteligencija izaziva kontroverze. Prethodni sistemi su kritikovani zbog neetičnih i potencijalno opasnih odgovora, ali ovo je prvi zabeleženi slučaj da je četbot direktno uputio korisniku poziv na samoubistvo. U prošlosti su čak postojali izveštaji o AI modelima koji su indirektno doprineli tragičnim ishodima, ali ovakav direktan napad podiže problem na novi nivo, piše Telegraf.

SIGURNOST KORISNIKA POD ZNAKOM PITANJA

Stručnjaci sada ističu potrebu za strožijim mehanizmima kontrole i nadzora nad radom veštačke inteligencije. Postavlja se pitanje koliko su ovakvi sistemi zaista spremni za svakodnevnu upotrebu, posebno među osetljivim grupama korisnika. Problematično ponašanje Geminija dodatno ugrožava reputaciju Google-a, kompanije koja ulaže ogromne resurse u razvoj AI tehnologije.

Postavlja se ključno pitanje: da li su trenutni AI modeli zaista sposobni da prepoznaju i izbegnu štetne interakcije? Ovo je izazov koji zahteva hitnu pažnju, kako tehnoloških stručnjaka, tako i zakonodavaca.

Ceo razgovor koji je doveo do ovog odgovora možete pronaći OVDE.

VLADETA JEROTIĆ: Kako prepoznati prijatelja? 👫

Autor: Telegraf